Исследование

критериев типа Граббса проверки наблюдений на аномальность

Критерий Граббса проверки на один выброс

Одновременная проверка на выброс наименьшего и наибольшего значения

Параметрический метод отбраковки

Ссылка:

Лемешко Б.Ю., Лемешко С.Б. Расширение области применения критериев типа Граббса, используемых при отбраковке аномальных измерений // Измерительная техника. 2005. № 6. – С. 13-19.

См. также: Прикладная математическая статистика (материалы к семинарам)

Введение

В практической деятельности по метрологии (при разработке, аттестации и применении методик выполнения измерений, при стандартизации методов контроля, испытаний, измерений, при оценке компетентности испытательных лабораторий) и в задачах статистического управления качеством важную роль играют статистические критерии, предназначенные для выделения аномальных наблюдений (выбросов). Если не исключить выбросы из анализируемых данных, то традиционно применяемые классические методы статистического анализа, как правило, не являющиеся робастными, чаще всего приводят к некорректным результатам.

Регламентируемые при решении вышеупомянутых задач методы отбраковки наблюдений в большинстве случаев опираются на предположение о принадлежности наблюдаемых величин нормальному закону. Это оправдано, хотя на практике предположение о нормальности, например, законов распределения ошибок измерений очень часто нарушается.

Наиболее часто для проверки наблюдений на выброс применяют простые критерии Граббса [1-3]. Критерии используются для проверки на аномальность наблюдений, принадлежащих выборкам из нормальной генеральной совокупности. Использование именно этих критериев предусматривает стандарт [4], представляющий собой аутентичный текст соответствующего международного стандарта ИСО 5725. Статистики критерия Граббса предусматривают возможность проверки на наличие в выборке либо одного аномального наблюдения (наименьшего или наибольшего), либо двух (двух наименьших в выборке или двух наибольших).

В данной работе мы хотели, во-первых, показать, как изменяются распределения статистик критерия Граббса при отклонении наблюдаемого закона от нормального. Это дает понимание того, что будет происходить с результатами применения критерия при нарушении предположений о нормальности. Вторая цель заключалась в реализации возможности применения критерия типа Граббса для проверки еще двух гипотез: a) для проверки на аномальность одновременно одного минимального и одного максимального элементов в выборке; b) для проверки на аномальность либо трех минимальных, либо трех максимальных элементов в выборке.

В основе данных исследований лежит методика статистического моделирования, опирающаяся на развиваемое программное обеспечение.

Критерий Граббса проверки на один выброс

Пусть ![]() – наблюдаемая выборка,

– наблюдаемая выборка, ![]() –

построенный по ней вариационный ряд. Проверяемая гипотеза

–

построенный по ней вариационный ряд. Проверяемая гипотеза ![]() заключается

в том, что все

заключается

в том, что все ![]() принадлежат одной генеральной

совокупности. При проверке на выброс наибольшего выборочного значения

конкурирующая гипотеза

принадлежат одной генеральной

совокупности. При проверке на выброс наибольшего выборочного значения

конкурирующая гипотеза ![]() заключается в том, что

заключается в том, что ![]() принадлежат

одному закону, а

принадлежат

одному закону, а ![]() – некоторому другому,

существенно сдвинутому вправо. При проверке на выброс

– некоторому другому,

существенно сдвинутому вправо. При проверке на выброс ![]() статистика

критерия Граббса имеет вид

статистика

критерия Граббса имеет вид

где

,

(2)

,

(2)

,

(3)

,

(3)

![]() .

(4)

.

(4)

При проверке на выброс наименьшего выборочного

значения конкурирующая гипотеза ![]() предполагает, что

предполагает, что ![]() принадлежит

некоторому другому закону, существенно сдвинутому влево. В данном случае

вычисляемая статистика принимает вид

принадлежит

некоторому другому закону, существенно сдвинутому влево. В данном случае

вычисляемая статистика принимает вид

![]() .

(5)

.

(5)

Максимальное или минимальное наблюдение считается

выбросом, если значение соответствующей статистики превысит критическое: ![]() или

или

![]() ,

где

,

где ![]() –

задаваемый уровень значимости.

–

задаваемый уровень значимости.

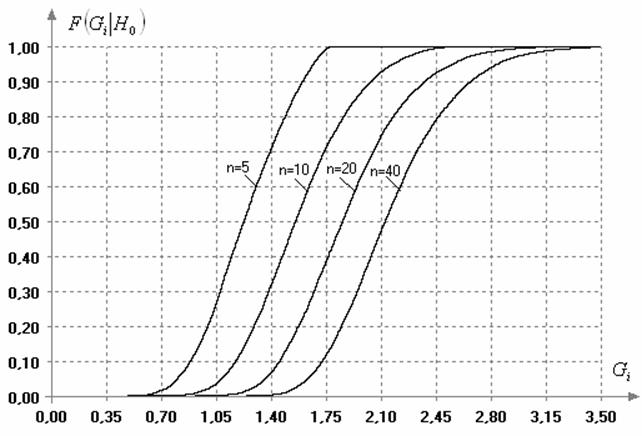

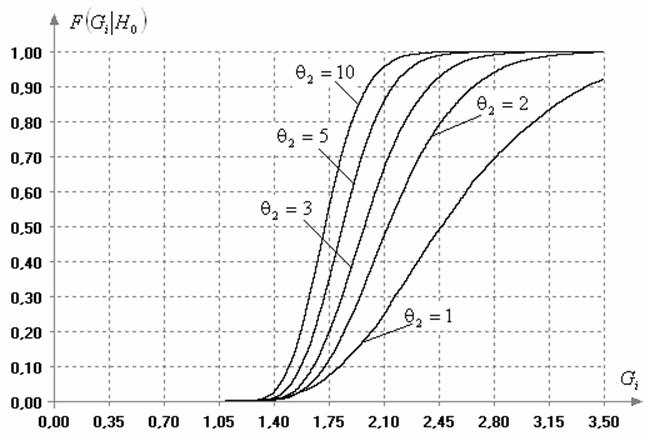

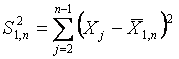

Статистики (1) и (5)

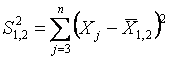

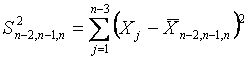

распределены одинаково. Вид условных распределений ![]() статистик (1) и (5) в зависимости от объема анализируемой

выборки при нормальном законе наблюдаемых величин представлен на рис.

1. Распределения статистики существенно зависят от объема выборки

статистик (1) и (5) в зависимости от объема анализируемой

выборки при нормальном законе наблюдаемых величин представлен на рис.

1. Распределения статистики существенно зависят от объема выборки ![]() .

Аналитический вид распределений статистики в стандарте [4] и

первоисточниках [1-3] не приводится. Даются лишь верхние

процентные точки для различных объемов выборок, так как решение об аномальности

проверяемого минимального или максимального выборочного значения принимается по

правому “хвосту” распределения статистики. Если в стандарте процентные точки

приведены для объемов выборок

.

Аналитический вид распределений статистики в стандарте [4] и

первоисточниках [1-3] не приводится. Даются лишь верхние

процентные точки для различных объемов выборок, так как решение об аномальности

проверяемого минимального или максимального выборочного значения принимается по

правому “хвосту” распределения статистики. Если в стандарте процентные точки

приведены для объемов выборок ![]() лишь от 3 до 40, то в [3] процентные точки приведены в диапазоне

лишь от 3 до 40, то в [3] процентные точки приведены в диапазоне ![]() до

147.

до

147.

Замечание: В таблице

процентных точек, приведенной в стандарте ([4], табл.5),

неверно указаны уровни значимости ![]() . На самом деле в данной таблице

представлены значения, соответствующие уровням значимости 0,005 и 0,025, а не

0,01 и 0,05. Чтобы убедиться в этом, достаточно обратиться к первоисточнику [3]. Данное несоответствие было замечено в процессе исследований

распределений статистик Граббса. Это замечание в силе и для процентных точек

статистик, предназначенных для анализа на выбросы одновременно двух минимальных

или двух максимальных выборочных значений. Вследствие такого недоразумения при

задании уровня значимости 0,01 или 0,05 и использовании процентных точек,

приведенных в стандарте ([4], табл.5), ошибочно не будет

отбраковываться часть выбросов.

. На самом деле в данной таблице

представлены значения, соответствующие уровням значимости 0,005 и 0,025, а не

0,01 и 0,05. Чтобы убедиться в этом, достаточно обратиться к первоисточнику [3]. Данное несоответствие было замечено в процессе исследований

распределений статистик Граббса. Это замечание в силе и для процентных точек

статистик, предназначенных для анализа на выбросы одновременно двух минимальных

или двух максимальных выборочных значений. Вследствие такого недоразумения при

задании уровня значимости 0,01 или 0,05 и использовании процентных точек,

приведенных в стандарте ([4], табл.5), ошибочно не будет

отбраковываться часть выбросов.

Рис. 1. Зависимость

распределения статистик (1) и (5) критерия Граббса от объема

выборок ![]() (в

случае нормального закона)

(в

случае нормального закона)

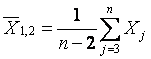

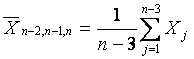

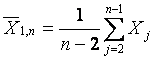

Критерий можно

использовать для отбраковки аномальных наблюдений только в случае нормального

закона. Если наблюдаемые случайные величины принадлежат некоторому другому

закону распределения, то предельное распределение статистик (1) и

(5) имеет другой вид. На рис.2 отражено изменение

распределений статистик (1) и (5) в случае принадлежности

наблюдаемой случайной величины различным законам экспоненциального семейства распределений

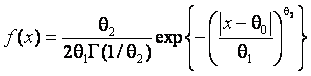

с плотностью

.

(6)

.

(6)

Частными случаями семейства

являются нормальный закон при параметре формы ![]() и

распределение Лапласа при

и

распределение Лапласа при ![]() .

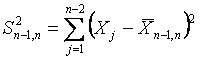

На рис.2 приведены распределения статистик (1)

и (5) при наблюдаемых законах (6) со значениями параметра формы

.

На рис.2 приведены распределения статистик (1)

и (5) при наблюдаемых законах (6) со значениями параметра формы ![]() и при объемах выборок

и при объемах выборок ![]() . Как видим, распределения статистик

отличаются очень сильно.

. Как видим, распределения статистик

отличаются очень сильно.

Рис.2.

Изменение распределений статистик (1) и (5) критерия Граббса

в случае различных законов семейства распределений (6) при ![]()

В [5] приводится несколько вариантов статистик типа (1), отличающиеся видами используемых оценок параметров сдвига и масштаба нормального закона. Все приводимые статистики, не смотря на похожесть, отличаются от статистики Граббса. Вследствие этого и распределения ни одной из этих статистик не совпадают со распределением статистик Граббса (1) и (5).

Проверка на два выброса

В этом случае конкурирующая гипотеза ![]() может

быть связана с предположением, что, например, некоторому другому закону

принадлежат

может

быть связана с предположением, что, например, некоторому другому закону

принадлежат ![]() и

и ![]() (либо

(либо ![]() и

и

![]() ).

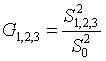

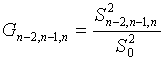

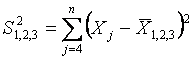

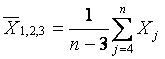

При проверке на выброс одновременно двух наибольших значений статистика

критерия Граббса имеет вид

).

При проверке на выброс одновременно двух наибольших значений статистика

критерия Граббса имеет вид

![]() ,

(7)

,

(7)

где

,

(8)

,

(8)

,

(9)

,

(9)

.

(10)

.

(10)

Для проверки на выброс одновременно двух наименьших

величин ![]() и

и

![]() статистика

критерия принимает вид

статистика

критерия принимает вид

![]() ,

(11)

,

(11)

где

,

(12)

,

(12)

.

(13)

.

(13)

Оба значения (![]() ,

,

![]() или

или ![]() ,

,

![]() )

считаются выбросами, если значение соответствующей статистики окажется ниже критического

)

считаются выбросами, если значение соответствующей статистики окажется ниже критического

![]() .

.

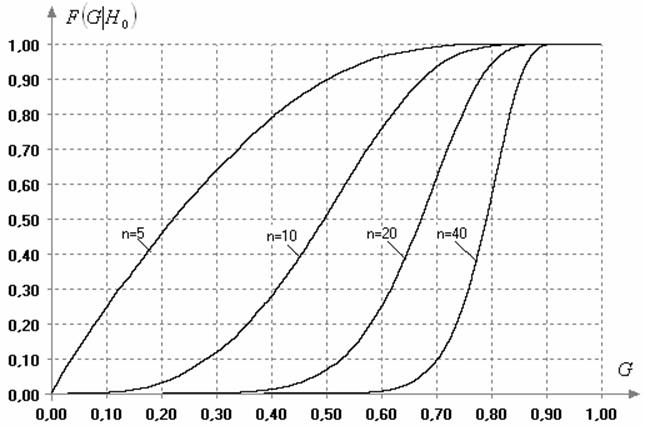

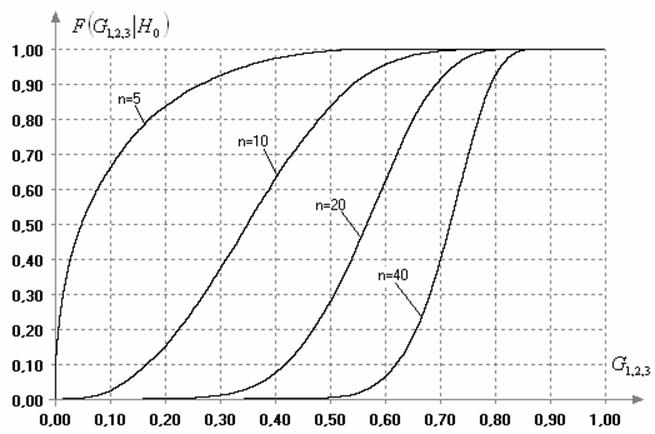

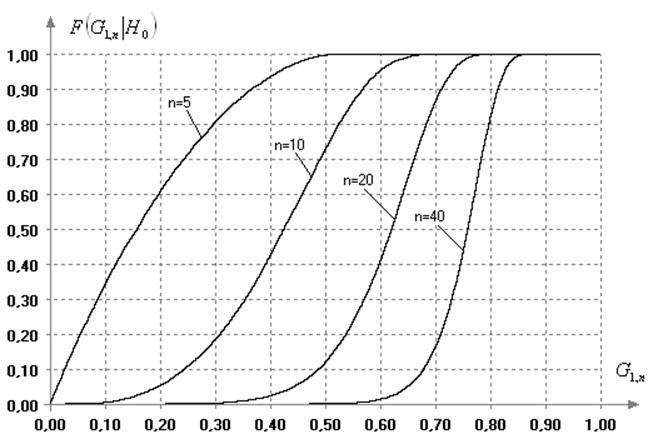

Вид условных распределений ![]() статистик

статистик

![]() (7) и (11) в зависимости от объема анализируемой выборки

представлен на рис. 3. Аналитический вид распределений

статистики

(7) и (11) в зависимости от объема анализируемой выборки

представлен на рис. 3. Аналитический вид распределений

статистики ![]() в стандарте [4]

и в [1-3] не приводится. Даются лишь нижние процентные точки для

различных объемов выборок, так как решение об аномальности одновременно двух

наименьших или двух наибольших выборочных значений принимается по левому

“хвосту” распределения статистики. В стандарте нижние процентные точки

приведены для объемов выборок

в стандарте [4]

и в [1-3] не приводится. Даются лишь нижние процентные точки для

различных объемов выборок, так как решение об аномальности одновременно двух

наименьших или двух наибольших выборочных значений принимается по левому

“хвосту” распределения статистики. В стандарте нижние процентные точки

приведены для объемов выборок ![]() лишь от 4 до 40. В первоисточнике

[3] нижние процентные точки распределения статистики

лишь от 4 до 40. В первоисточнике

[3] нижние процентные точки распределения статистики ![]() приведены в диапазоне

приведены в диапазоне ![]() до 149.

до 149.

Рис. 3. Зависимость распределения статистик (7) и (11) критерия Граббса от объема выборок (в случае нормального закона)

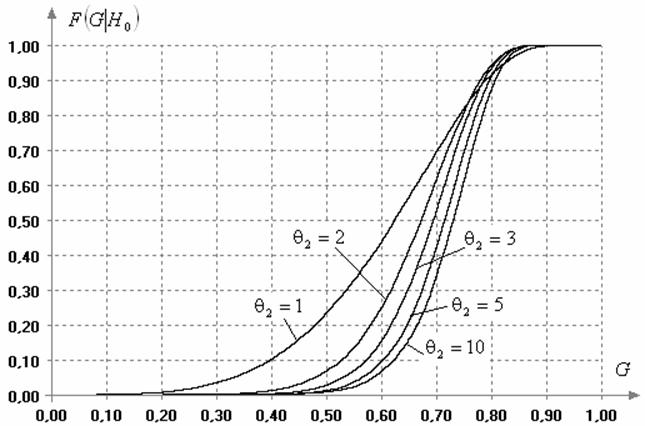

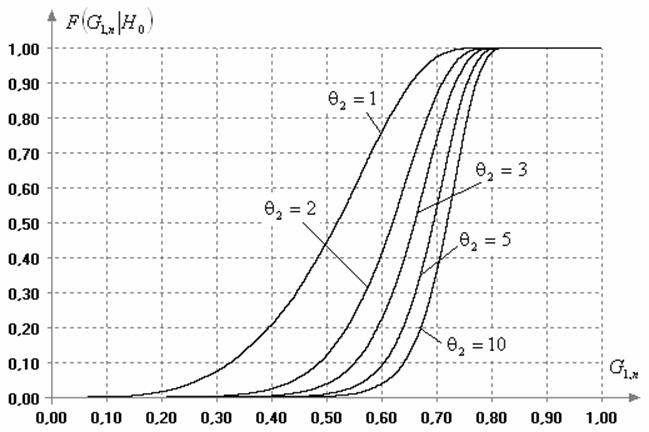

Если наблюдаемые

случайные величины принадлежат некоторому другому закону, отличному от

нормального, то распределения статистик (7) и (11) принимают

иной вид. Например, на рис. 4 приведены распределения

статистик (7) и (11) при наблюдаемых законах вида (6) со значениями параметра формы ![]() при объемах

выборок

при объемах

выборок ![]() .

Как следует из картины, представленной на этом рисунке, распределения статистик

Граббса (7) и (11) очень сильно зависят от вида закона,

которому принадлежат наблюдаемые величины.

.

Как следует из картины, представленной на этом рисунке, распределения статистик

Граббса (7) и (11) очень сильно зависят от вида закона,

которому принадлежат наблюдаемые величины.

Рис. 4.

Изменение распределений статистик (7) и (11) Граббса в случае

различных законов распределения при ![]()

Как и в первом случае, критерий со статистиками (7) – (11) можно применять для отбраковки аномальных наблюдений, используя таблицы процентных точек, приведенные в [4] и в [3], только в случае нормального закона. Если наблюдаемый закон отличается от нормального, то использование указанных таблиц, как следует из картин, представленных на рисунках 2 и 4, может приводить как к пропуску выбросов, так и к причислению к аномальным наблюдений, не являющихся таковыми.

Проверка на три выброса

Подход (7) – (13), можно естественно развивать для построения статистик, предназначенных, например, для проверки на аномальность одновременно трех минимальных или трех максимальных выборочных значений, или для проверки на выброс одновременно минимального и максимального значений в выборке. Для этого необходимо исследовать лишь распределения соответствующих статистик.

В случае

проверки на аномальность одновременно трех минимальных или трех максимальных

выборочных значений конкурирующая гипотеза ![]() предполагает,

что некоторому другому закону принадлежат

предполагает,

что некоторому другому закону принадлежат ![]() ,

, ![]() и

и

![]() (либо

(либо

![]() ,

,

![]() и

и

![]() ).

Статистики для проверки на аномальность одновременно трех минимальных или трех

максимальных выборочных значений формируются в соответствии с соотношениями:

).

Статистики для проверки на аномальность одновременно трех минимальных или трех

максимальных выборочных значений формируются в соответствии с соотношениями:

,

(14)

,

(14)

,

(15)

,

(15)

где

,

(16)

,

(16)

.

(17)

.

(17)

,

(18)

,

(18)

.

(19)

.

(19)

Статистики (14) и (15) распределены одинаково. Все

три измерения считаются выбросами, если значение соответствующей статистики

окажется ниже критического: ![]() или

или ![]() .

.

Естественно, что

распределения данных статистик также являются зависящими от объема выборок ![]() .

На рис. 5 показана зависимость от

.

На рис. 5 показана зависимость от ![]() условных

распределений

условных

распределений ![]() и

и ![]() статистик (14) и (15) в случае извлечения выборок из

нормальной генеральной совокупности. Вычисленные с использованием методики

статистического моделирования нижние процентные точки (

статистик (14) и (15) в случае извлечения выборок из

нормальной генеральной совокупности. Вычисленные с использованием методики

статистического моделирования нижние процентные точки (![]() =0.1%,

0.5%, 1%, 5%, 10%) распределений статистик (14) и (15) при

=0.1%,

0.5%, 1%, 5%, 10%) распределений статистик (14) и (15) при ![]() представлены в таблице

1. Процентные точки строились по моделируемым выборкам статистик. Объем

каждой выборки, по которым оценивались процентные точки, составлял 50000

смоделированных значений статистики. В таблице приведены значения процентных

точек, полученные усреднением по 15 таким экспериментам.

представлены в таблице

1. Процентные точки строились по моделируемым выборкам статистик. Объем

каждой выборки, по которым оценивались процентные точки, составлял 50000

смоделированных значений статистики. В таблице приведены значения процентных

точек, полученные усреднением по 15 таким экспериментам.

Рис. 5. Зависимость распределения статистик (14) и (15) от объема выборок (в случае нормального закона)

Таблица 1. Нижние процентные точки статистик (14) – (15) критерия типа Граббса

|

|

0.1% |

0.5% |

1% |

2.5% |

5% |

10% |

|

5 |

0.0000 |

0.0000 |

0.0000 |

0.0001 |

0.0004 |

0.0015 |

|

6 |

0.0002 |

0.0009 |

0.0019 |

0.0048 |

0.0099 |

0.0207 |

|

7 |

0.0023 |

0.0065 |

0.0106 |

0.0200 |

0.0332 |

0.0552 |

|

8 |

0.0079 |

0.0186 |

0.0268 |

0.0437 |

0.0640 |

0.0943 |

|

9 |

0.0176 |

0.0355 |

0.0478 |

0.0711 |

0.0966 |

0.1333 |

|

10 |

0.0314 |

0.0561 |

0.0717 |

0.1001 |

0.1302 |

0.1703 |

|

11 |

0.0471 |

0.0779 |

0.0968 |

0.1293 |

0.1619 |

0.2047 |

|

12 |

0.0659 |

0.1012 |

0.1222 |

0.1576 |

0.1925 |

0.2368 |

|

13 |

0.0841 |

0.1237 |

0.1471 |

0.1850 |

0.2206 |

0.2660 |

|

14 |

0.1035 |

0.1468 |

0.1707 |

0.2104 |

0.2475 |

0.2935 |

|

15 |

0.1234 |

0.1692 |

0.1943 |

0.2351 |

0.2726 |

0.3182 |

|

16 |

0.1412 |

0.1905 |

0.2170 |

0.2583 |

0.2962 |

0.3419 |

|

17 |

0.1607 |

0.2109 |

0.2374 |

0.2799 |

0.3178 |

0.3631 |

|

18 |

0.1797 |

0.2309 |

0.2583 |

0.3008 |

0.3382 |

0.3828 |

|

19 |

0.1973 |

0.2503 |

0.2782 |

0.3197 |

0.3575 |

0.4016 |

|

20 |

0.2161 |

0.2688 |

0.2966 |

0.3387 |

0.3757 |

0.4190 |

|

21 |

0.2313 |

0.2856 |

0.3139 |

0.3558 |

0.3924 |

0.4348 |

|

22 |

0.2488 |

0.3023 |

0.3303 |

0.3718 |

0.4082 |

0.4505 |

|

23 |

0.2643 |

0.3197 |

0.3466 |

0.3881 |

0.4238 |

0.4645 |

|

24 |

0.2795 |

0.3339 |

0.3606 |

0.4020 |

0.4375 |

0.4782 |

|

25 |

0.2952 |

0.3491 |

0.3762 |

0.4164 |

0.4510 |

0.4906 |

|

26 |

0.3091 |

0.3625 |

0.3890 |

0.4294 |

0.4638 |

0.5028 |

|

27 |

0.3209 |

0.3750 |

0.4022 |

0.4415 |

0.4756 |

0.5144 |

|

28 |

0.3357 |

0.3887 |

0.4151 |

0.4536 |

0.4874 |

0.5250 |

|

29 |

0.3475 |

0.4001 |

0.4270 |

0.4658 |

0.4984 |

0.5353 |

|

30 |

0.3608 |

0.4127 |

0.4382 |

0.4763 |

0.5087 |

0.5451 |

|

31 |

0.3710 |

0.4228 |

0.4486 |

0.4867 |

0.5186 |

0.5544 |

|

32 |

0.3797 |

0.4331 |

0.4596 |

0.4968 |

0.5282 |

0.5634 |

|

33 |

0.3935 |

0.4441 |

0.4692 |

0.5060 |

0.5370 |

0.5716 |

|

34 |

0.4040 |

0.4547 |

0.4793 |

0.5151 |

0.5456 |

0.5798 |

|

35 |

0.4131 |

0.4643 |

0.4885 |

0.5242 |

0.5541 |

0.5876 |

|

36 |

0.4239 |

0.4730 |

0.4974 |

0.5330 |

0.5623 |

0.5952 |

|

37 |

0.4317 |

0.4824 |

0.5064 |

0.5411 |

0.5697 |

0.6023 |

|

38 |

0.4414 |

0.4915 |

0.5149 |

0.5487 |

0.5772 |

0.6090 |

|

39 |

0.4511 |

0.4999 |

0.5228 |

0.5563 |

0.5843 |

0.6158 |

|

40 |

0.4610 |

0.5077 |

0.5296 |

0.5630 |

0.5910 |

0.6219 |

|

41 |

0.4667 |

0.5146 |

0.5381 |

0.5706 |

0.5978 |

0.6279 |

|

42 |

0.4751 |

0.5226 |

0.5452 |

0.5774 |

0.6041 |

0.6338 |

|

43 |

0.4839 |

0.5299 |

0.5517 |

0.5836 |

0.6102 |

0.6397 |

|

44 |

0.4910 |

0.5366 |

0.5585 |

0.5899 |

0.6159 |

0.6450 |

|

45 |

0.4997 |

0.5436 |

0.5651 |

0.5960 |

0.6217 |

0.6504 |

|

46 |

0.5057 |

0.5498 |

0.5713 |

0.6020 |

0.6274 |

0.6553 |

|

47 |

0.5131 |

0.5562 |

0.5775 |

0.6075 |

0.6327 |

0.6605 |

|

48 |

0.5191 |

0.5622 |

0.5833 |

0.6131 |

0.6380 |

0.6653 |

|

49 |

0.5247 |

0.5684 |

0.5891 |

0.6183 |

0.6430 |

0.6698 |

|

50 |

0.5316 |

0.5745 |

0.5947 |

0.6239 |

0.6477 |

0.6743 |

|

51 |

0.5374 |

0.5803 |

0.6000 |

0.6284 |

0.6524 |

0.6786 |

|

52 |

0.5436 |

0.5853 |

0.6051 |

0.6333 |

0.6568 |

0.6828 |

|

53 |

0.5491 |

0.5909 |

0.6104 |

0.6383 |

0.6616 |

0.6870 |

|

54 |

0.5540 |

0.5956 |

0.6150 |

0.6427 |

0.6660 |

0.6910 |

|

55 |

0.5605 |

0.6009 |

0.6199 |

0.6471 |

0.6697 |

0.6948 |

|

56 |

0.5664 |

0.6060 |

0.6246 |

0.6514 |

0.6739 |

0.6985 |

|

57 |

0.5706 |

0.6107 |

0.6295 |

0.6555 |

0.6777 |

0.7023 |

|

58 |

0.5753 |

0.6156 |

0.6338 |

0.6597 |

0.6816 |

0.7056 |

|

59 |

0.5803 |

0.6191 |

0.6375 |

0.6639 |

0.6855 |

0.7091 |

|

60 |

0.5860 |

0.6238 |

0.6423 |

0.6678 |

0.6891 |

0.7124 |

|

61 |

0.5898 |

0.6280 |

0.6461 |

0.6717 |

0.6925 |

0.7158 |

|

62 |

0.5963 |

0.6333 |

0.6507 |

0.6753 |

0.6962 |

0.7191 |

|

63 |

0.5997 |

0.6364 |

0.6543 |

0.6793 |

0.6997 |

0.7222 |

|

64 |

0.6042 |

0.6409 |

0.6578 |

0.6824 |

0.7026 |

0.7250 |

|

65 |

0.6084 |

0.6446 |

0.6618 |

0.6861 |

0.7060 |

0.7280 |

|

66 |

0.6127 |

0.6479 |

0.6651 |

0.6892 |

0.7089 |

0.7310 |

|

67 |

0.6164 |

0.6518 |

0.6685 |

0.6926 |

0.7122 |

0.7339 |

|

68 |

0.6202 |

0.6556 |

0.6722 |

0.6958 |

0.7152 |

0.7365 |

|

69 |

0.6245 |

0.6592 |

0.6753 |

0.6988 |

0.7181 |

0.7393 |

|

70 |

0.6283 |

0.6626 |

0.6789 |

0.7022 |

0.7210 |

0.7418 |

|

71 |

0.6310 |

0.6658 |

0.6820 |

0.7051 |

0.7239 |

0.7444 |

|

72 |

0.6362 |

0.6695 |

0.6854 |

0.7078 |

0.7265 |

0.7469 |

|

73 |

0.6388 |

0.6728 |

0.6884 |

0.7109 |

0.7292 |

0.7494 |

|

74 |

0.6432 |

0.6759 |

0.6913 |

0.7136 |

0.7317 |

0.7519 |

|

75 |

0.6449 |

0.6787 |

0.6940 |

0.7163 |

0.7345 |

0.7541 |

|

76 |

0.6497 |

0.6816 |

0.6974 |

0.7189 |

0.7370 |

0.7566 |

|

77 |

0.6526 |

0.6851 |

0.7002 |

0.7217 |

0.7394 |

0.7586 |

|

78 |

0.6558 |

0.6878 |

0.7028 |

0.7241 |

0.7416 |

0.7610 |

|

79 |

0.6589 |

0.6911 |

0.7060 |

0.7269 |

0.7442 |

0.7632 |

|

80 |

0.6624 |

0.6938 |

0.7084 |

0.7293 |

0.7465 |

0.7652 |

|

81 |

0.6645 |

0.6965 |

0.7108 |

0.7315 |

0.7486 |

0.7673 |

|

82 |

0.6681 |

0.6992 |

0.7139 |

0.7339 |

0.7508 |

0.7692 |

|

83 |

0.6710 |

0.7015 |

0.7157 |

0.7361 |

0.7528 |

0.7712 |

|

84 |

0.6747 |

0.7045 |

0.7184 |

0.7384 |

0.7551 |

0.7732 |

|

85 |

0.6769 |

0.7072 |

0.7212 |

0.7410 |

0.7571 |

0.7750 |

|

86 |

0.6800 |

0.7094 |

0.7234 |

0.7429 |

0.7592 |

0.7770 |

|

87 |

0.6819 |

0.7114 |

0.7254 |

0.7452 |

0.7612 |

0.7789 |

|

88 |

0.6845 |

0.7143 |

0.7280 |

0.7476 |

0.7634 |

0.7806 |

|

89 |

0.6875 |

0.7165 |

0.7303 |

0.7494 |

0.7652 |

0.7825 |

|

90 |

0.6897 |

0.7185 |

0.7323 |

0.7515 |

0.7672 |

0.7843 |

|

91 |

0.6937 |

0.7217 |

0.7346 |

0.7534 |

0.7689 |

0.7860 |

|

92 |

0.6956 |

0.7235 |

0.7368 |

0.7554 |

0.7707 |

0.7876 |

|

93 |

0.6988 |

0.7259 |

0.7388 |

0.7572 |

0.7725 |

0.7893 |

|

94 |

0.7003 |

0.7280 |

0.7409 |

0.7594 |

0.7744 |

0.7909 |

|

95 |

0.7029 |

0.7303 |

0.7429 |

0.7612 |

0.7761 |

0.7924 |

|

96 |

0.7050 |

0.7325 |

0.7448 |

0.7630 |

0.7779 |

0.7940 |

|

97 |

0.7077 |

0.7341 |

0.7469 |

0.7649 |

0.7795 |

0.7957 |

|

98 |

0.7089 |

0.7363 |

0.7486 |

0.7666 |

0.7811 |

0.7971 |

|

99 |

0.7119 |

0.7382 |

0.7507 |

0.7684 |

0.7827 |

0.7986 |

|

100 |

0.7145 |

0.7404 |

0.7526 |

0.7702 |

0.7845 |

0.8002 |

|

101 |

0.7170 |

0.7422 |

0.7540 |

0.7717 |

0.7860 |

0.8015 |

|

102 |

0.7188 |

0.7441 |

0.7559 |

0.7732 |

0.7875 |

0.8030 |

|

103 |

0.7209 |

0.7460 |

0.7579 |

0.7750 |

0.7890 |

0.8044 |

|

104 |

0.7224 |

0.7479 |

0.7596 |

0.7765 |

0.7904 |

0.8058 |

|

105 |

0.7243 |

0.7495 |

0.7613 |

0.7782 |

0.7919 |

0.8070 |

|

106 |

0.7264 |

0.7512 |

0.7631 |

0.7799 |

0.7934 |

0.8084 |

|

107 |

0.7276 |

0.7529 |

0.7648 |

0.7812 |

0.7948 |

0.8097 |

|

108 |

0.7307 |

0.7548 |

0.7665 |

0.7827 |

0.7963 |

0.8110 |

|

109 |

0.7322 |

0.7567 |

0.7678 |

0.7842 |

0.7977 |

0.8122 |

|

110 |

0.7339 |

0.7585 |

0.7698 |

0.7858 |

0.7990 |

0.8135 |

|

111 |

0.7361 |

0.7601 |

0.7713 |

0.7871 |

0.8004 |

0.8148 |

|

112 |

0.7380 |

0.7616 |

0.7729 |

0.7888 |

0.8017 |

0.8160 |

|

113 |

0.7394 |

0.7633 |

0.7745 |

0.7900 |

0.8031 |

0.8172 |

|

114 |

0.7416 |

0.7647 |

0.7759 |

0.7914 |

0.8044 |

0.8184 |

|

115 |

0.7431 |

0.7665 |

0.7775 |

0.7929 |

0.8056 |

0.8195 |

|

116 |

0.7441 |

0.7680 |

0.7789 |

0.7942 |

0.8068 |

0.8207 |

|

117 |

0.7464 |

0.7694 |

0.7801 |

0.7955 |

0.8079 |

0.8218 |

|

118 |

0.7484 |

0.7709 |

0.7818 |

0.7968 |

0.8092 |

0.8230 |

|

119 |

0.7497 |

0.7724 |

0.7830 |

0.7982 |

0.8105 |

0.8241 |

|

120 |

0.7505 |

0.7738 |

0.7846 |

0.7995 |

0.8117 |

0.8250 |

|

121 |

0.7531 |

0.7753 |

0.7859 |

0.8007 |

0.8128 |

0.8262 |

|

122 |

0.7547 |

0.7768 |

0.7872 |

0.8019 |

0.8140 |

0.8273 |

|

123 |

0.7560 |

0.7782 |

0.7886 |

0.8030 |

0.8151 |

0.8283 |

|

124 |

0.7579 |

0.7793 |

0.7897 |

0.8043 |

0.8162 |

0.8293 |

|

125 |

0.7592 |

0.7808 |

0.7911 |

0.8054 |

0.8174 |

0.8304 |

|

126 |

0.7610 |

0.7824 |

0.7926 |

0.8068 |

0.8184 |

0.8314 |

|

127 |

0.7624 |

0.7834 |

0.7934 |

0.8079 |

0.8197 |

0.8324 |

|

128 |

0.7631 |

0.7850 |

0.7950 |

0.8091 |

0.8205 |

0.8333 |

|

129 |

0.7653 |

0.7859 |

0.7960 |

0.8102 |

0.8216 |

0.8343 |

|

130 |

0.7662 |

0.7877 |

0.7974 |

0.8112 |

0.8228 |

0.8353 |

|

131 |

0.7686 |

0.7889 |

0.7985 |

0.8123 |

0.8237 |

0.8362 |

|

132 |

0.7696 |

0.7901 |

0.7996 |

0.8135 |

0.8247 |

0.8371 |

|

133 |

0.7706 |

0.7911 |

0.8006 |

0.8146 |

0.8257 |

0.8380 |

|

134 |

0.7721 |

0.7924 |

0.8018 |

0.8155 |

0.8267 |

0.8388 |

|

135 |

0.7730 |

0.7934 |

0.8032 |

0.8168 |

0.8277 |

0.8398 |

|

136 |

0.7749 |

0.7949 |

0.8042 |

0.8176 |

0.8286 |

0.8407 |

|

137 |

0.7757 |

0.7958 |

0.8051 |

0.8186 |

0.8296 |

0.8416 |

|

138 |

0.7771 |

0.7968 |

0.8063 |

0.8195 |

0.8306 |

0.8424 |

|

139 |

0.7785 |

0.7979 |

0.8074 |

0.8206 |

0.8314 |

0.8432 |

|

140 |

0.7803 |

0.7993 |

0.8086 |

0.8216 |

0.8324 |

0.8441 |

|

141 |

0.7806 |

0.8003 |

0.8096 |

0.8226 |

0.8333 |

0.8450 |

|

142 |

0.7821 |

0.8013 |

0.8104 |

0.8235 |

0.8341 |

0.8458 |

|

143 |

0.7834 |

0.8026 |

0.8116 |

0.8246 |

0.8351 |

0.8466 |

|

144 |

0.7841 |

0.8038 |

0.8127 |

0.8254 |

0.8360 |

0.8474 |

|

145 |

0.7853 |

0.8044 |

0.8135 |

0.8262 |

0.8367 |

0.8481 |

|

146 |

0.7866 |

0.8056 |

0.8148 |

0.8274 |

0.8377 |

0.8489 |

|

147 |

0.7883 |

0.8067 |

0.8155 |

0.8283 |

0.8384 |

0.8497 |

|

148 |

0.7895 |

0.8078 |

0.8166 |

0.8291 |

0.8393 |

0.8505 |

|

149 |

0.7902 |

0.8088 |

0.8174 |

0.8299 |

0.8400 |

0.8513 |

|

150 |

0.7915 |

0.8099 |

0.8184 |

0.8309 |

0.8410 |

0.8520 |

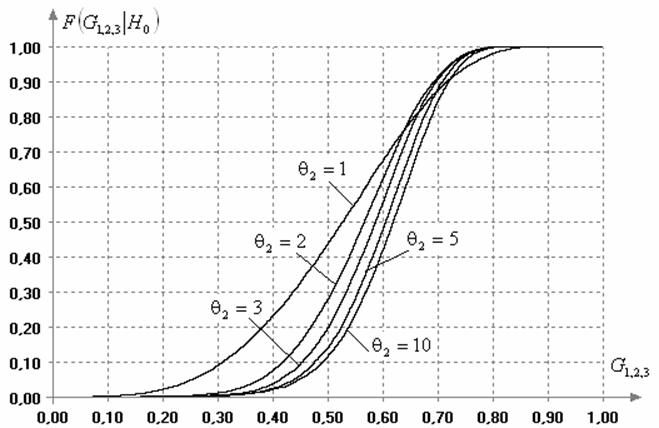

Распределения статистик (14) – (15)

также зависят от наблюдаемого закона. Рис. 6 иллюстрирует

поведение распределений данных статистик при наблюдаемых законах вида (6) со

значениями параметра формы ![]() при объемах выборок

при объемах выборок ![]() .

.

Рис. 6.

Изменение распределений статистик (14) и (15) в случае

различных законов семейства распределений (6) при ![]()

Одновременная проверка на выброс наименьшего и наибольшего

значения

Статистика для

проверки на аномальность одновременно минимального и максимального

выборочных значений формируется в соответствии с соотношением:

,

(20)

,

(20)

где

,

(21)

,

(21)

.

(22)

.

(22)

Оба значения считаются выбросами при заданном уровне

значимости ![]() , если вычисленное по выборке значение

статистики (20) окажется ниже критического:

, если вычисленное по выборке значение

статистики (20) окажется ниже критического: ![]() .

.

Вид условных распределений ![]() статистики

(20)

статистики

(20) ![]() в зависимости от объема

в зависимости от объема ![]() в

случае извлечения анализируемой выборки из нормальной генеральной совокупности

представлен на рис. 7. Вычисленные с использованием методики

статистического моделирования нижние процентные точки распределений статистики

(14) при

в

случае извлечения анализируемой выборки из нормальной генеральной совокупности

представлен на рис. 7. Вычисленные с использованием методики

статистического моделирования нижние процентные точки распределений статистики

(14) при ![]() приведены в таблице

2.

приведены в таблице

2.

Рис. 7. Зависимость распределения статистики (20) от объема выборки (в случае нормального закона)

Таблица 2. Нижние процентные точки статистик (20) критерия типа Граббса

|

|

0.1% |

0.5% |

1% |

2.5% |

5% |

10% |

|

5 |

0.0003 |

0.0012 |

0.0025 |

0.0063 |

0.0129 |

0.0265 |

|

6 |

0.0030 |

0.0089 |

0.0140 |

0.0262 |

0.0427 |

0.0698 |

|

7 |

0.0110 |

0.0243 |

0.0349 |

0.0562 |

0.0809 |

0.1178 |

|

8 |

0.0242 |

0.0468 |

0.0620 |

0.0908 |

0.1218 |

0.1644 |

|

9 |

0.0408 |

0.0712 |

0.0908 |

0.1252 |

0.1608 |

0.2073 |

|

10 |

0.0610 |

0.0991 |

0.1215 |

0.1606 |

0.1981 |

0.2464 |

|

11 |

0.0845 |

0.1279 |

0.1529 |

0.1939 |

0.2334 |

0.2821 |

|

12 |

0.1072 |

0.1544 |

0.1813 |

0.2247 |

0.2648 |

0.3135 |

|

13 |

0.1307 |

0.1813 |

0.2091 |

0.2538 |

0.2948 |

0.3428 |

|

14 |

0.1527 |

0.2065 |

0.2356 |

0.2808 |

0.3219 |

0.3696 |

|

15 |

0.1747 |

0.2313 |

0.2605 |

0.3059 |

0.3463 |

0.3936 |

|

16 |

0.1964 |

0.2537 |

0.2837 |

0.3291 |

0.3697 |

0.4160 |

|

17 |

0.2162 |

0.2756 |

0.3052 |

0.3512 |

0.3907 |

0.4367 |

|

18 |

0.2357 |

0.2969 |

0.3268 |

0.3718 |

0.4110 |

0.4556 |

|

19 |

0.2571 |

0.3164 |

0.3465 |

0.3912 |

0.4298 |

0.4730 |

|

20 |

0.2762 |

0.3358 |

0.3650 |

0.4094 |

0.4474 |

0.4895 |

|

21 |

0.2950 |

0.3543 |

0.3829 |

0.4264 |

0.4636 |

0.5051 |

|

22 |

0.3114 |

0.3702 |

0.3994 |

0.4424 |

0.4787 |

0.5191 |

|

23 |

0.3268 |

0.3864 |

0.4154 |

0.4573 |

0.4932 |

0.5326 |

|

24 |

0.3448 |

0.4013 |

0.4297 |

0.4714 |

0.5064 |

0.5451 |

|

25 |

0.3590 |

0.4153 |

0.4440 |

0.4848 |

0.5187 |

0.5567 |

|

26 |

0.3732 |

0.4294 |

0.4576 |

0.4973 |

0.5310 |

0.5679 |

|

27 |

0.3865 |

0.4423 |

0.4699 |

0.5097 |

0.5422 |

0.5784 |

|

28 |

0.3994 |

0.4547 |

0.4818 |

0.5208 |

0.5529 |

0.5884 |

|

29 |

0.4133 |

0.4673 |

0.4930 |

0.5317 |

0.5631 |

0.5978 |

|

30 |

0.4257 |

0.4791 |

0.5050 |

0.5422 |

0.5731 |

0.6067 |

|

31 |

0.4376 |

0.4885 |

0.5145 |

0.5511 |

0.5819 |

0.6152 |

|

32 |

0.4477 |

0.4995 |

0.5249 |

0.5608 |

0.5908 |

0.6235 |

|

33 |

0.4558 |

0.5099 |

0.5346 |

0.5702 |

0.5993 |

0.6314 |

|

34 |

0.4688 |

0.5189 |

0.5431 |

0.5783 |

0.6072 |

0.6384 |

|

35 |

0.4779 |

0.5285 |

0.5524 |

0.5864 |

0.6149 |

0.6456 |

|

36 |

0.4874 |

0.5374 |

0.5612 |

0.5946 |

0.6225 |

0.6525 |

|

37 |

0.4970 |

0.5459 |

0.5688 |

0.6022 |

0.6296 |

0.6591 |

|

38 |

0.5048 |

0.5540 |

0.5767 |

0.6091 |

0.6359 |

0.6652 |

|

39 |

0.5145 |

0.5617 |

0.5839 |

0.6166 |

0.6425 |

0.6711 |

|

40 |

0.5211 |

0.5692 |

0.5917 |

0.6229 |

0.6489 |

0.6768 |

|

41 |

0.5307 |

0.5767 |

0.5985 |

0.6295 |

0.6548 |

0.6823 |

|

42 |

0.5385 |

0.5835 |

0.6052 |

0.6360 |

0.6606 |

0.6877 |

|

43 |

0.5450 |

0.5902 |

0.6117 |

0.6417 |

0.6662 |

0.6928 |

|

44 |

0.5522 |

0.5970 |

0.6181 |

0.6476 |

0.6715 |

0.6977 |

|

45 |

0.5599 |

0.6033 |

0.6237 |

0.6529 |

0.6767 |

0.7025 |

|

46 |

0.5675 |

0.6090 |

0.6295 |

0.6582 |

0.6817 |

0.7071 |

|

47 |

0.5742 |

0.6154 |

0.6356 |

0.6637 |

0.6865 |

0.7115 |

|

48 |

0.5789 |

0.6211 |

0.6412 |

0.6687 |

0.6913 |

0.7159 |

|

49 |

0.5861 |

0.6270 |

0.6461 |

0.6733 |

0.6957 |

0.7200 |

|

50 |

0.5910 |

0.6324 |

0.6512 |

0.6783 |

0.7002 |

0.7240 |

|

51 |

0.5972 |

0.6374 |

0.6557 |

0.6824 |

0.7044 |

0.7278 |

|

52 |

0.6037 |

0.6420 |

0.6605 |

0.6868 |

0.7085 |

0.7315 |

|

53 |

0.6086 |

0.6475 |

0.6655 |

0.6916 |

0.7126 |

0.7351 |

|

54 |

0.6147 |

0.6520 |

0.6698 |

0.6955 |

0.7163 |

0.7388 |

|

55 |

0.6186 |

0.6571 |

0.6746 |

0.6995 |

0.7198 |

0.7420 |

|

56 |

0.6244 |

0.6617 |

0.6791 |

0.7037 |

0.7237 |

0.7456 |

|

57 |

0.6291 |

0.6657 |

0.6828 |

0.7072 |

0.7271 |

0.7488 |

|

58 |

0.6337 |

0.6696 |

0.6870 |

0.7112 |

0.7308 |

0.7521 |

|

59 |

0.6385 |

0.6744 |

0.6910 |

0.7148 |

0.7341 |

0.7548 |

|

60 |

0.6434 |

0.6786 |

0.6948 |

0.7182 |

0.7372 |

0.7579 |

|

61 |

0.6468 |

0.6825 |

0.6984 |

0.7217 |

0.7405 |

0.7608 |

|

62 |

0.6520 |

0.6858 |

0.7020 |

0.7250 |

0.7435 |

0.7636 |

|

63 |

0.6553 |

0.6895 |

0.7056 |

0.7282 |

0.7467 |

0.7665 |

|

64 |

0.6595 |

0.6931 |

0.7093 |

0.7316 |

0.7496 |

0.7692 |

|

65 |

0.6641 |

0.6974 |

0.7126 |

0.7345 |

0.7524 |

0.7717 |

|

66 |

0.6677 |

0.7006 |

0.7159 |

0.7375 |

0.7552 |

0.7743 |

|

67 |

0.6706 |

0.7033 |

0.7187 |

0.7403 |

0.7578 |

0.7768 |

|

68 |

0.6752 |

0.7067 |

0.7221 |

0.7432 |

0.7604 |

0.7791 |

|

69 |

0.6799 |

0.7106 |

0.7255 |

0.7462 |

0.7632 |

0.7815 |

|

70 |

0.6824 |

0.7137 |

0.7280 |

0.7487 |

0.7655 |

0.7837 |

|

71 |

0.6862 |

0.7167 |

0.7309 |

0.7515 |

0.7681 |

0.7860 |

|

72 |

0.6890 |

0.7192 |

0.7338 |

0.7540 |

0.7706 |

0.7883 |

|

73 |

0.6922 |

0.7229 |

0.7369 |

0.7567 |

0.7729 |

0.7904 |

|

74 |

0.6956 |

0.7251 |

0.7391 |

0.7591 |

0.7752 |

0.7926 |

|

75 |

0.6992 |

0.7286 |

0.7422 |

0.7615 |

0.7775 |

0.7947 |

|

76 |

0.7025 |

0.7313 |

0.7447 |

0.7638 |

0.7794 |

0.7966 |

|

77 |

0.7052 |

0.7338 |

0.7472 |

0.7663 |

0.7819 |

0.7986 |

|

78 |

0.7074 |

0.7360 |

0.7494 |

0.7686 |

0.7840 |

0.8005 |

|

79 |

0.7110 |

0.7388 |

0.7521 |

0.7706 |

0.7861 |

0.8024 |

|

80 |

0.7137 |

0.7418 |

0.7547 |

0.7730 |

0.7881 |

0.8044 |

|

81 |

0.7169 |

0.7438 |

0.7566 |

0.7750 |

0.7901 |

0.8061 |

|

82 |

0.7189 |

0.7464 |

0.7590 |

0.7772 |

0.7919 |

0.8079 |

|

83 |

0.7215 |

0.7488 |

0.7614 |

0.7792 |

0.7938 |

0.8097 |

|

84 |

0.7246 |

0.7509 |

0.7635 |

0.7812 |

0.7957 |

0.8114 |

|

85 |

0.7275 |

0.7537 |

0.7660 |

0.7833 |

0.7975 |

0.8130 |

|

86 |

0.7288 |

0.7556 |

0.7678 |

0.7853 |

0.7994 |

0.8147 |

|

87 |

0.7321 |

0.7581 |

0.7703 |

0.7873 |

0.8012 |

0.8163 |

|

88 |

0.7337 |

0.7598 |

0.7718 |

0.7890 |

0.8028 |

0.8178 |

|

89 |

0.7372 |

0.7620 |

0.7739 |

0.7909 |

0.8046 |

0.8194 |

|

90 |

0.7395 |

0.7644 |

0.7762 |

0.7927 |

0.8062 |

0.8210 |

|

91 |

0.7418 |

0.7665 |

0.7780 |

0.7945 |

0.8079 |

0.8224 |

|

92 |

0.7437 |

0.7683 |

0.7797 |

0.7961 |

0.8095 |

0.8240 |

|

93 |

0.7464 |

0.7703 |

0.7817 |

0.7980 |

0.8111 |

0.8253 |

|

94 |

0.7484 |

0.7726 |

0.7837 |

0.7996 |

0.8126 |

0.8267 |

|

95 |

0.7497 |

0.7738 |

0.7852 |

0.8012 |

0.8141 |

0.8282 |

|

96 |

0.7522 |

0.7758 |

0.7869 |

0.8029 |

0.8157 |

0.8296 |

|

97 |

0.7547 |

0.7779 |

0.7891 |

0.8045 |

0.8172 |

0.8309 |

|

98 |

0.7567 |

0.7798 |

0.7905 |

0.8060 |

0.8185 |

0.8322 |

|

99 |

0.7577 |

0.7818 |

0.7921 |

0.8075 |

0.8200 |

0.8335 |

|

100 |

0.7604 |

0.7833 |

0.7939 |

0.8090 |

0.8213 |

0.8348 |

|

101 |

0.7626 |

0.7849 |

0.7956 |

0.8105 |

0.8227 |

0.8360 |

|

102 |

0.7645 |

0.7866 |

0.7972 |

0.8119 |

0.8241 |

0.8372 |

|

103 |

0.7661 |

0.7877 |

0.7983 |

0.8134 |

0.8254 |

0.8385 |

|

104 |

0.7680 |

0.7897 |

0.8001 |

0.8148 |

0.8267 |

0.8397 |

|

105 |

0.7698 |

0.7916 |

0.8017 |

0.8161 |

0.8279 |

0.8407 |

|

106 |

0.7712 |

0.7932 |

0.8031 |

0.8176 |

0.8291 |

0.8419 |

|

107 |

0.7735 |

0.7946 |

0.8046 |

0.8188 |

0.8304 |

0.8430 |

|

108 |

0.7749 |

0.7963 |

0.8061 |

0.8202 |

0.8316 |

0.8442 |

|

109 |

0.7768 |

0.7975 |

0.8073 |

0.8214 |

0.8328 |

0.8454 |

|

110 |

0.7787 |

0.7991 |

0.8089 |

0.8229 |

0.8341 |

0.8464 |

|

111 |

0.7799 |

0.8004 |

0.8104 |

0.8240 |

0.8353 |

0.8475 |

|

112 |

0.7811 |

0.8019 |

0.8115 |

0.8252 |

0.8364 |

0.8485 |

|

113 |

0.7829 |

0.8035 |

0.8131 |

0.8266 |

0.8375 |

0.8495 |

|

114 |

0.7843 |

0.8047 |

0.8141 |

0.8276 |

0.8386 |

0.8506 |

|

115 |

0.7862 |

0.8059 |

0.8156 |

0.8289 |

0.8398 |

0.8515 |

|

116 |

0.7876 |

0.8076 |

0.8167 |

0.8300 |

0.8408 |

0.8526 |

|

117 |

0.7900 |

0.8088 |

0.8180 |

0.8310 |

0.8419 |

0.8536 |

|

118 |

0.7903 |

0.8104 |

0.8191 |

0.8322 |

0.8429 |

0.8546 |

|

119 |

0.7924 |

0.8113 |

0.8203 |

0.8333 |

0.8440 |

0.8554 |

|

120 |

0.7939 |

0.8127 |

0.8218 |

0.8344 |

0.8450 |

0.8564 |

|

121 |

0.7953 |

0.8139 |

0.8230 |

0.8356 |

0.8461 |

0.8573 |

|

122 |

0.7965 |

0.8152 |

0.8242 |

0.8367 |

0.8470 |

0.8582 |

|

123 |

0.7980 |

0.8164 |

0.8251 |

0.8377 |

0.8480 |

0.8591 |

|

124 |

0.7996 |

0.8179 |

0.8265 |

0.8388 |

0.8489 |

0.8601 |

|

125 |

0.8007 |

0.8189 |

0.8275 |

0.8399 |

0.8499 |

0.8609 |

|

126 |

0.8019 |

0.8202 |

0.8286 |

0.8407 |

0.8508 |

0.8617 |

|

127 |

0.8038 |

0.8214 |

0.8298 |

0.8418 |

0.8517 |

0.8626 |

|

128 |

0.8040 |

0.8223 |

0.8308 |

0.8427 |

0.8527 |

0.8635 |

|

129 |

0.8058 |

0.8234 |

0.8318 |

0.8437 |

0.8536 |

0.8642 |

|

130 |

0.8070 |

0.8247 |

0.8329 |

0.8448 |

0.8545 |

0.8651 |

|

131 |

0.8082 |

0.8255 |

0.8338 |

0.8456 |

0.8554 |

0.8659 |

|

132 |

0.8092 |

0.8267 |

0.8348 |

0.8466 |

0.8563 |

0.8667 |

|

133 |

0.8106 |

0.8276 |

0.8360 |

0.8475 |

0.8572 |

0.8675 |

|

134 |

0.8118 |

0.8290 |

0.8369 |

0.8484 |

0.8578 |

0.8682 |

|

135 |

0.8138 |

0.8299 |

0.8379 |

0.8493 |

0.8588 |

0.8690 |

|

136 |

0.8137 |

0.8311 |

0.8390 |

0.8502 |

0.8596 |

0.8697 |

|

137 |

0.8153 |

0.8322 |

0.8400 |

0.8512 |

0.8604 |

0.8705 |

|

138 |

0.8163 |

0.8330 |

0.8408 |

0.8520 |

0.8612 |

0.8712 |

|

139 |

0.8173 |

0.8340 |

0.8418 |

0.8528 |

0.8620 |

0.8720 |

|

140 |

0.8186 |

0.8351 |

0.8426 |

0.8536 |

0.8627 |

0.8727 |

|

141 |

0.8194 |

0.8360 |

0.8437 |

0.8545 |

0.8634 |

0.8733 |

|

142 |

0.8211 |

0.8369 |

0.8444 |

0.8554 |

0.8643 |

0.8741 |

|

143 |

0.8219 |

0.8381 |

0.8454 |

0.8561 |

0.8651 |

0.8748 |

|

144 |

0.8227 |

0.8389 |

0.8464 |

0.8570 |

0.8658 |

0.8755 |

|

145 |

0.8237 |

0.8398 |

0.8472 |

0.8577 |

0.8665 |

0.8761 |

|

146 |

0.8251 |

0.8409 |

0.8481 |

0.8585 |

0.8673 |

0.8768 |

|

147 |

0.8260 |

0.8415 |

0.8488 |

0.8593 |

0.8681 |

0.8775 |

|

148 |

0.8268 |

0.8426 |

0.8497 |

0.8601 |

0.8687 |

0.8782 |

|

149 |

0.8280 |

0.8432 |

0.8505 |

0.8608 |

0.8694 |

0.8788 |

|

150 |

0.8289 |

0.8442 |

0.8513 |

0.8616 |

0.8701 |

0.8794 |

Распределения статистики (20)

существенно зависят от наблюдаемого закона. Рис. 8 показывает,

как меняются распределение данной статистики при наблюдаемых законах вида (6) со значениями параметра формы ![]() при объемах

выборок

при объемах

выборок ![]() .

.

Рис. 8.

Изменение распределений статистики (20) в случае различных

законов семейства распределений (6) при ![]()

Каждый из рассмотренных критериев позволяет достаточно надежно отбраковывать содержащиеся в выборке аномальные наблюдения, если количество выбросов не превышает их числа, на которое рассчитан соответствующий критерий. В тех случаях, когда используемый критерий соответствует реальному числу выбросов, последние, как правило, отбраковываются. При числе выбросов большем, чем предусматривает статистика, критерий уже не способен их выделять. Например, если проверка на выброс одного наибольшего значения не дала положительного результата, это еще не означает, что данное наблюдение не является выбросом. Возможно, что в выборке содержится больше наблюдений, которые могут интерпретироваться как аномальные. Присутствие таких наблюдений отражается на оценках дисперсии (3), (8), и оценках характеристик рассеяния (9), (12), (16), (18), (21), так как все они не являются робастными. Следовательно, при использовании критериев типа Граббса необходимо последовательно тестировать выборку на различное число выбросов.

Выбросы в результатах измерений могут быть вызваны появлением “сдвинутых” наблюдений, связанных с систематической ошибкой, могут быть связаны с увеличением рассеяния результатов измерений в силу различных причин. В последнем случае к выбросам могут относиться как наименьшие, так и наибольшие значения. Способность рассмотренных критериев выделять аномальные наблюдения будет зависеть от вида засорения.

В качестве

примера рассмотрим мощность критериев на модели с симметричным засорением, кода

выборка из нормальной генеральной совокупности с параметром сдвига ![]() и

параметром масштаба

и

параметром масштаба ![]() засорена 10% наблюдений

нормального закона с параметрами

засорена 10% наблюдений

нормального закона с параметрами ![]() и 5

и 5![]() . Мощность критерия

при заданной вероятности

. Мощность критерия

при заданной вероятности ![]() ошибки первого рода определяется

величиной

ошибки первого рода определяется

величиной ![]() , где

, где ![]() – вероятность

ошибки второго рода. В данном случае ошибка второго рода заключается в том, что

аномальное наблюдение не идентифицируется как таковое. В таблице

3 приведены мощности критериев проверки на аномальность одного минимального

(или максимального) наблюдения, одновременно двух минимальных (двух

максимальных) наблюдений, одновременно одного минимального и одного

максимального наблюдений в выборке объемом

– вероятность

ошибки второго рода. В данном случае ошибка второго рода заключается в том, что

аномальное наблюдение не идентифицируется как таковое. В таблице

3 приведены мощности критериев проверки на аномальность одного минимального

(или максимального) наблюдения, одновременно двух минимальных (двух

максимальных) наблюдений, одновременно одного минимального и одного

максимального наблюдений в выборке объемом ![]() . Более высокая в

данном случае мощность критерия со статистикой (20)

объясняется симметричностью засорения.

. Более высокая в

данном случае мощность критерия со статистикой (20)

объясняется симметричностью засорения.

Таблица 3. Значения мощности ![]() критериев

типа Граббса по отношению к смеси с 10% симметричным засорением при

критериев

типа Граббса по отношению к смеси с 10% симметричным засорением при ![]()

|

Уровень

значимости |

Мощность критерия |

||

|

со статистикой (1) и (5) |

со статистикой (7) и (11) |

со статистикой (20) |

|

|

0.10 |

0.3763 |

0.3586 |

0.6094 |

|

0.05 |

0.3285 |

0.3115 |

0.5448 |

|

0.01 |

0.2431 |

0.2351 |

0.4164 |

Параметрический

метод отбраковки

Таблицы процентных точек критериев Граббса, полученные в [1-3], сокращенная таблица, приведенная в [4], расширения критерия, рассмотренные в данной работе, и построенные здесь таблицы соответствующих процентных точек позволяют корректно отбраковывать аномальные наблюдения (выбросы) в случае выполнения предположения о нормальности наблюдаемого закона. Если предположения о нормальности нарушаются, использовать указанные таблицы процентных точек нельзя. Как показано выше, распределения статистик критериев типа Граббса существенно зависят от истинного закона распределения наблюдаемой случайной величины.

Вообще говоря, если возникнет такая необходимость, нет принципиальных трудностей для построения модели распределения любой рассмотренной статистики критерия типа Граббса (или для определения процентных точек) при любом законе наблюдаемых случайных величин. Проблема лишь в том, что законов, для которых желательно иметь эффективную процедуру отбраковки аномальных измерений, слишком много.

Логичней при

анализе наблюдений на аномальность опираться на “истинный” закон

распределения наблюдаемой величины. В этом случае задача отбраковки,

формулируется следующим образом. Проверяемая гипотеза ![]() заключается

в том, что все

заключается

в том, что все ![]() принадлежат одной генеральной

совокупности с законом распределения

принадлежат одной генеральной

совокупности с законом распределения ![]() . При проверке на выброс наибольшего

выборочного значения

. При проверке на выброс наибольшего

выборочного значения ![]() конкурирующая гипотеза

конкурирующая гипотеза ![]() заключается

в том, что

заключается

в том, что ![]() принадлежат

принадлежат ![]() ,

а

,

а ![]() –

некоторому распределению

–

некоторому распределению ![]() , которое “существенно сдвинуто

вправо” относительно

, которое “существенно сдвинуто

вправо” относительно ![]() , например,

, например, ![]() , где

, где ![]() достаточно

велико. Если

достаточно

велико. Если ![]() , то принимается гипотеза

, то принимается гипотеза ![]() ,

в противном случае - гипотеза

,

в противном случае - гипотеза ![]() . При справедливости нулевой

гипотезы

. При справедливости нулевой

гипотезы ![]() , и критическое значение определяется

из уравнения

, и критическое значение определяется

из уравнения ![]() .

.

При проверке на выброс наименьшего значения ![]() гипотеза

гипотеза ![]() принимается,

если

принимается,

если ![]() .

В этом случае

.

В этом случае ![]() , и критическое значение определяется

из уравнения

, и критическое значение определяется

из уравнения ![]() .

.

Чтобы надежно

отбраковывать аномальные наблюдения с помощью такой процедуры, необходимо

знание “истинного” закона ![]() . Однако на практике вектор параметров

. Однако на практике вектор параметров

![]() закона

закона

![]() чаще

всего приходится оценивать по этой же самой выборке. Поэтому такую процедуру

отбраковки иногда называют параметрической. Содержащиеся в выборке выбросы

отражаются на оценках параметров закона

чаще

всего приходится оценивать по этой же самой выборке. Поэтому такую процедуру

отбраковки иногда называют параметрической. Содержащиеся в выборке выбросы

отражаются на оценках параметров закона ![]() . Закон

. Закон ![]() оказывается

существенно отличающимся от “истинного”. Вследствие этого параметрические

методы отбраковки резко выделяющихся наблюдений становятся неустойчивыми [6].

оказывается

существенно отличающимся от “истинного”. Вследствие этого параметрические

методы отбраковки резко выделяющихся наблюдений становятся неустойчивыми [6].

Следует отметить, что подобным же недостатком обладают и критерии типа Граббса: нет никакой гарантии, что в выборке не больше аномальных измерений, чем мы исследуем на выбросы. Тогда это может отрицательно сказаться на результатах анализа.

В параметрических методах отбраковки с данным недостатком борются, применяя робастные методы оценивания, например, оценки максимального правдоподобия по группированным данным [7], оптимальные L-оценки по выборочным квантилям [8, 9], MD-оценки. Использование в процедуре параметрической отбраковки робастных методов оценивания делает ее очень эффективной [7].

Робастные методы оценивания математического ожидания и среднего квадратичного отклонения можно использовать и при вычислении статистик критериев типа Граббса. Однако в этом случае обязательно следует учитывать, что это отразится на распределениях статистик.

Работа выполнена при финансовой поддержке Минобразования РФ (проект № ТО2-3.3-3356)

Литература

- Frank E. Grubbs. Sample Criteria for Testing Outlying observations // Ann. Math. Statist, 1950. – Vol. 21. – No. 1. – P.27-58.

- Frank E. Grubbs. Procedures for Detecting Outlying Observations in Samples // Technometrics, 1969. – Vol. 11. – No. 1. – P.1-21

- Frank E. Grubbs, Glenn Beck. Extension of sample sizes and percentage points for significance tests of outlying observations // Technometrics, 1972. – Vol. 14. – No. 4. – P.847-854.

- ГОСТ Р ИСО 5725-2–2002. Точность (правильность и прецизионность) методов и результатов измерений. Часть 2. М.: Изд-во стандартов. – 51 с.

- Большев Л.Н., Смирнов Н.В. Таблицы математической статистики. – М.: Наука, 1983. – 416 с.

- Орлов А.И. Неустойчивость параметрических методов отбраковки резко выделяющихся наблюдений // Заводская лаборатория. 1992. Т. 58. № 7. С. 40-42.

- Лемешко Б.Ю. Робастные методы оценивания и отбраковка аномальных измерений // Заводская лаборатория. - 1997. - Т.63. - № 5. - С. 43-49.

- Лемешко Б.Ю., Чимитова Е.В. Построение оптимальных L-оценок параметров сдвига и масштаба распределений по выборочным квантилям // Сибирский журнал индустриальной математики. 2001. - Т.4. - № 2. - С. 166-183.

- Лемешко Б.Ю., Чимитова Е.В. Оптимальные L-оценки параметров сдвига и масштаба распределений по выборочным квантилям // Заводская лаборатория. Диагностика материалов. 2004. – Т.70. – №1

Приложение 1. Верхние процентные

точки статистик (1) и (5) критерия Граббса

|

|

0.1% |

0.5% |

1% |

2.5% |

5% |

10% |

|

3 |

1.155 |

1.155 |

1.155 |

1.155 |

1.153 |

1.148 |

|

4 |

1.499 |

1.496 |

1.492 |

1.431 |

1.463 |

1.425 |

|

5 |

1.780 |

1.764 |

1.749 |

1.715 |

1.672 |

1.602 |

|

6 |

2.011 |

1.973 |

1.944 |

1.887 |

1.822 |

1.729 |

|

7 |

2.201 |

2.139 |

2.097 |

2.020 |

1.938 |

1.828 |

|

8 |

2.358 |

2.274 |

2.221 |

2.126 |

2.032 |

1.909 |

|

9 |

2.492 |

2.387 |

2.323 |

2.215 |

2.110 |

1.977 |

|

10 |

2.606 |

2.482 |

2.410 |

2.290 |

2.176 |

2.036 |

|

11 |

2.705 |

2.564 |

2.485 |

2.355 |

2.234 |

2.088 |

|

12 |

2.791 |

2.636 |

2.550 |

2.412 |

2.285 |

2.134 |

|

13 |

2.867 |

2.699 |

2.607 |

2.462 |

2.331 |

2.175 |

|

14 |

2.935 |

2.755 |

2.659 |

2.507 |

2.371 |

2.213 |

|

15 |

2.997 |

2.806 |

2.705 |

2.549 |

2.409 |

2.247 |

|

16 |

3.052 |

2.852 |

2.747 |

2.585 |

2.443 |

2.279 |

|

17 |

3.103 |

2.894 |

2.785 |

2.620 |

2.475 |

2.309 |

|

18 |

3.149 |

2.932 |

2.821 |

2.651 |

2.504 |

2.335 |

|

19 |

3.191 |

2.968 |

2.854 |

2.681 |

2.532 |

2.361 |

|

20 |

3.230 |

3.001 |

2.884 |

2.709 |

2.557 |

2.385 |

|

21 |

3.266 |

3.031 |

2.912 |

2.733 |

2.580 |

2.408 |

|

22 |

3.300 |

3.060 |

2.939 |

2.758 |

2.603 |

2.429 |

|

23 |

3.332 |

3.087 |

2.963 |

2.781 |

2.624 |

2.448 |

|

24 |

3.362 |

3.112 |

2.987 |

2.802 |

2.644 |

2.467 |

|

25 |

3.389 |

3.135 |

3.009 |

2.822 |

2.663 |

2.486 |

|

26 |

3.415 |

3.157 |

3.029 |

2.841 |

2.681 |

2.502 |

|

27 |

3.440 |

3.178 |

3.049 |

2.859 |

2.698 |

2.519 |

|

28 |

3.464 |

3.199 |

3.068 |

2.876 |

2.714 |

2.534 |

|

29 |

3.486 |

3.218 |

3.085 |

2.893 |

2.730 |

2.549 |

|

30 |

3.507 |

3.236 |

3.103 |

2.908 |

2.745 |

2.563 |

|

31 |

3.528 |

3.253 |

3.119 |

2.924 |

2.759 |

2.577 |

|

32 |

3.546 |

3.270 |

3.135 |

2.938 |

2.773 |

2.591 |

|

33 |

3.565 |

3.286 |

3.150 |

2.952 |

2.786 |

2.604 |

|

34 |

3.582 |

3.301 |

3.164 |

2.965 |

2.799 |

2.616 |

|

35 |

3.599 |

3.316 |

3.178 |

2.979 |

2.811 |

2.628 |

|

36 |

3.616 |

3.330 |

3.191 |

2.991 |

2.823 |

2.639 |

|

37 |

3.631 |

3.343 |

3.204 |

3.003 |

2.835 |

2.650 |

|

38 |

3.646 |

3.356 |

3.216 |

3.014 |

2.846 |

2.661 |

|

39 |

3.660 |

3.369 |

3.228 |

3.025 |

2.857 |

2.671 |

|

40 |

3.673 |

3.381 |

3.240 |

3.036 |

2.866 |

2.682 |

|

41 |

3.687 |

3.393 |

3.251 |

3.046 |

2.877 |

2.692 |

|

42 |

3.700 |

3.404 |

3.261 |

3.057 |

2.887 |

2.700 |

|

43 |

3.712 |

3.415 |

3.271 |

3.067 |

2.896 |

2.710 |

|

44 |

3.724 |

3.425 |

3.282 |

3.075 |

2.905 |

2.719 |

|

45 |

3.736 |

3.435 |

3.292 |

3.085 |

2.914 |

2.727 |

|

46 |

3.747 |

3.445 |

3.302 |

3.094 |

2.923 |

2.736 |

|

47 |

3.757 |

3.455 |

3.310 |

3.103 |

2.931 |

2.744 |

|

48 |

3.768 |

3.464 |

3.319 |

3.111 |

2.940 |

2.753 |

|

49 |

3.779 |

3.474 |

3.329 |

3.120 |

2.948 |

2.760 |

|

50 |

3.789 |

3.483 |

3.336 |

3.128 |

2.956 |

2.768 |

|

51 |

3.798 |

3.491 |

3.345 |

3.136 |

2.964 |

2.775 |

|

52 |

3.808 |

3.500 |

3.353 |

3.143 |

2.971 |

2.783 |

|

53 |

3.316 |

3.507 |

3.361 |

3.151 |

2.973 |

2.790 |

|

54 |

3.825 |

3.516 |

3.368 |

3.158 |

2.986 |

2.798 |

|

55 |

3.834 |

3.524 |

3.376 |

3.166 |

2.992 |

2.804 |

|

56 |

3.842 |

3.531 |

3.383 |

3.172 |

3.000 |

2.811 |

|

57 |

3.851 |

3.539 |

3.391 |

3.180 |

3.006 |

2.818 |

|

58 |

3.858 |

3.546 |

3.397 |

3.186 |

3.013 |

2.824 |

|

59 |

3.867 |

3.553 |

3.405 |

3.193 |

3.019 |

2.831 |

|

60 |

3.874 |

3.560 |

3.411 |

3.199 |

3.035 |

2.837 |

|

61 |

3.382 |

3.566 |

3.418 |

3.205 |

3.032 |

2.842 |

|

62 |

3.889 |

3.573 |

3.424 |

3.212 |

3.037 |

2.349 |

|

63 |

3.896 |

3.579 |

3.430 |

3.218 |

3.044 |

2.854 |

|

64 |

3.903 |

3.586 |

3.437 |

3.224 |

3.049 |

2.860 |

|

65 |

3.910 |

3.592 |

3.442 |

3.230 |

3.055 |

2.866 |

|

66 |

3.917 |

3.598 |

3.449 |

3.235 |

3.061 |

2.871 |

|

67 |

3.923 |

3.605 |

3.454 |

3.241 |

3.066 |

0.288 |

|

68 |

3.930 |

3.610 |

3.460 |

3.246 |

3.071 |

2.883 |

|

69 |

3.936 |

3.617 |

3.466 |

3.252 |

3.076 |

2.888 |

|

70 |

3.942 |

3.622 |

3.471 |

3.257 |

3.082 |

2.893 |

|

71 |

3.948 |

3.627 |

3.476 |

3.262 |

3.087 |

2.897 |

|

72 |

3.954 |

3.633 |

3.482 |

3.267 |

3.092 |

2.903 |

|

73 |

3.960 |

3.638 |

3.487 |

3.272 |

3.098 |

2.908 |

|

74 |

3.965 |

3.643 |

3.492 |

3.278 |

3.102 |

2.912 |

|

75 |

3.971 |

3.648 |

3.496 |

3.282 |

3.107 |

2.917 |

|

76 |

3.977 |

3.654 |

3.502 |

3.287 |

3.111 |

2.922 |

|

77 |

3.982 |

3.658 |

3.507 |

3.291 |

3.117 |

2.927 |

|

78 |

3.987 |

3.663 |

3.511 |

3.297 |

3.121 |

2.931 |

|

79 |

3.992 |

3.669 |

3.516 |

3.301 |

3.125 |

2.935 |

|

80 |

3.998 |

3.673 |

3.521 |

3.305 |

3.130 |

2.940 |

|

81 |

4.002 |

3.677 |

3.525 |

3.309 |

3.134 |

2.945 |

|

82 |

4.007 |

3.682 |

3.529 |

3.315 |

3.139 |

2.949 |

|

83 |

4.012 |

3.687 |

3.534 |

3.319 |

3.143 |

0.295 |

|

84 |

4.017 |

3.691 |

3.539 |

3.323 |

3.147 |

2.957 |

|

85 |

4.021 |

3.695 |

3.543 |

3.327 |

3.151 |

2.961 |

|

86 |

4.026 |

3.699 |

3.547 |

3.331 |

3.155 |

2.966 |

|

87 |

4.031 |

3.704 |

3.551 |

3.335 |

3.160 |

2.970 |

|

88 |

4.035 |

3.708 |

3.555 |

3.339 |

3.163 |

2.973 |

|

89 |

4.039 |

3.712 |

3.559 |

3.343 |

3.167 |

2.977 |

|

90 |

4.044 |

3.716 |

3.563 |

3.347 |

3.171 |

2.981 |

|

91 |

4.049 |

3.720 |

3.567 |

3.350 |

3.174 |

2.984 |

|

92 |

4.053 |

3.725 |

3.570 |

3.355 |

3.179 |

2.989 |

|

93 |

4.067 |

3.728 |

3.575 |

3.358 |

3.182 |

2.993 |

|

94 |

4.060 |

3.732 |

3.579 |

3.362 |

3.186 |

2.996 |

|

95 |

4.064 |

3.736 |

3.582 |

3.365 |

3.189 |

3.000 |

|

96 |

4.069 |

3.739 |

3.586 |

3.369 |

3.193 |

3.003 |

|

97 |

4.073 |

3.744 |

3.589 |

3.372 |

3.196 |

3.006 |

|

98 |

4.076 |

3.747 |

3.593 |

3.377 |

3.201 |

3.011 |

|

99 |

4.080 |

3.750 |

3.597 |

3.380 |

3.204 |

3.014 |

|

100 |

4.084 |

3.754 |

3.600 |

3.383 |

3.207 |

3.017 |

|

101 |

4.088 |

3.757 |

3.603 |

3.386 |

3.210 |

3.021 |

|

102 |

4.092 |

3.760 |

3.607 |

3.390 |

3.214 |

3.024 |

|

103 |

4.095 |

3.765 |

3.610 |

3.393 |

3.217 |

3.027 |

|

104 |

4.098 |

3.768 |

3.614 |

3.397 |

3.220 |

3.030 |

|

105 |

4.102 |

3.771 |

3.617 |

3.400 |

3.224 |

3.033 |

|

106 |

4.105 |

3.774 |

3.620 |

3.403 |

3.227 |

3.037 |

|

107 |

4.109 |

3.777 |

3.623 |

3.406 |

3.230 |

3.040 |

|

108 |

4.112 |

3.780 |

3.626 |

3.409 |

3.233 |

3.043 |

|

109 |

4.116 |

3.784 |

3.629 |

3.412 |

3.236 |

3.046 |

|

110 |

4.119 |

3.787 |

3.632 |

3.415 |

3.239 |

3.049 |

|

111 |

4.122 |

3.790 |

3.636 |

3.418 |

3.242 |

3.052 |

|

112 |

4.125 |

3.793 |

3.639 |

3.422 |

3.245 |

3.055 |

|

113 |

4.129 |

3.796 |

3.642 |

3.424 |

3.248 |

3.058 |

|

114 |

4.132 |

3.799 |

3.645 |

3.427 |

3.251 |

3.061 |

|

115 |

4.135 |

3.802 |

3.647 |

3.430 |

3.254 |

3.064 |

|

116 |

4.138 |

3.805 |

3.650 |

3.433 |

3.257 |

3.067 |

|

117 |

4.141 |

3.808 |

3.653 |

3.435 |

3.259 |

3.070 |

|

118 |

4.144 |

3.811 |

3.656 |

3.438 |

3.262 |

3.073 |

|

119 |

4.146 |

3.814 |

3.659 |

3.441 |

3.265 |

3.075 |

|

120 |

4.150 |

3.817 |

3.662 |

3.444 |

3.267 |

3.073 |

|

121 |

4.153 |

3.819 |

3.665 |

3.447 |

3.270 |

3.081 |

|

122 |

4.156 |

3.822 |

3.667 |

3.450 |

3.274 |

3.083 |

|

123 |

4.159 |

3.824 |

3.670 |

3.452 |

3.276 |

3.086 |

|

124 |

4.161 |

3.827 |

3.672 |

3.455 |

3.279 |

3.089 |

|

125 |

4.164 |

3.831 |

3.675 |

3.457 |

3.281 |

3.092 |

|

126 |

4.166 |

3.833 |

3.677 |

3.460 |

3.284 |

3.095 |

|

127 |

4.169 |

3.836 |

3.680 |

3.462 |

3.286 |

3.097 |

|

128 |

4.173 |

3.838 |

3.683 |

3.465 |

3.289 |

3.100 |

|

129 |

4.175 |

3.840 |

3.686 |

3.467 |

3.291 |

3.102 |

|

130 |

4.178 |

3.843 |

3.688 |

3.470 |

3.294 |

3.104 |

|

131 |

4.180 |

3.845 |

3.690 |

3.473 |

3.296 |

3.107 |

|

132 |

4.133 |

3.848 |

3.693 |

3.475 |

3.298 |

3.109 |

|

133 |

4.185 |

3.850 |

3.695 |

3.478 |

3.302 |

3.112 |

|

134 |

4.188 |

3.853 |

3.697 |

3.480 |

3.304 |

3.114 |

|

135 |

4.190 |

3.856 |

3.700 |

3.482 |

3.306 |

3.116 |

|

136 |

4.193 |

3.858 |

3.702 |

3.484 |

3.309 |

3.119 |

|

137 |

4.196 |

3.860 |

3.704 |

3.487 |

3.311 |

3.122 |

|

138 |

4.198 |

3.863 |

3.707 |

3.489 |

3.313 |

3.124 |

|

139 |

4.200 |

3.865 |

3.710 |

3.491 |

3.315 |

3.126 |

|

140 |

4.203 |

3.867 |

3.712 |

3.493 |

3.318 |

3.129 |

|

141 |

4.205 |

3.869 |

3.714 |

3.497 |

3.320 |

3.131 |

|

142 |

4.207 |

3.871 |

3.716 |

3.499 |

3.322 |

3.133 |

|

143 |

4.209 |

3.874 |

3.719 |

3.501 |

3.324 |

3.135 |

|

144 |

4.212 |

3.876 |

3.721 |

3.503 |

3.326 |

3.138 |

|

145 |

4.214 |

3.879 |

3.723 |

3.505 |

3.328 |

3.140 |

|

146 |

4.216 |

3.881 |

3.725 |

3.507 |